-

随着无人机的普及和发展,无人机的“黑飞”行为也越来越威胁到公共安全,尤其在大型公园和游乐场等公共场所,抵制“黑飞”的反无人机系统研发迫在眉睫[1]。识别无人机是反无人机系统的首要和关键问题之一,运用图像识别无人机是重要的识别方法之一。图像识别的关键在于图像特征的提取,使用显著对象作为图像内容的表示。根据特征提取的方式不同,分为传统图像特征手动提取方法和神经网络自动提取特征两种图像识别方法[2]。

随着技术的发展,手动提取特征已经被神经网络自动提取所取代。图像识别的神经网络模型发展很快。2012年,Krizhevshy等人提出的AlexNet[3]模型使ImageNet数据集的分类准确率得到明显提高;2014年,由Google团队提出的GoogLeNet[4]模型通过引入Inception模块增加网络宽度,从而提高模型的表达能力;同年由Simonyan等人提出的VGG[5]模型通过多个小感受野卷积核堆叠的方式代替大感受野的卷积核,从而减少网络参数;2015年,由He等人提出的ResNet[6]模型通过引入残差块结构解决了网络因为层数增加导致的梯度消失和梯度爆炸现象。目前,大部分的卷积神经网络对大样本的识别效果好,准确率高;样本越充分,效果越好[7]。但是对于小样本效果不佳,准确率不高。如何设计一种网络,针对无人机小样本,能够提取更多的特征,提高识别准确率成为了亟待解决的问题。

文中提出了一种基于迁移学习、密集卷积网络和坐标注意力机制融合的图像识别方法。运用迁移学习节省训练时间,并提高准确率;使用密集卷积网络识别小样本,增多样本的提取通道,增多了特征的提取;由于采用了密集卷积网络,在增加特征提取的同时,也增加了无效通道;运用坐标注意力机制突出有效通道,抑制无效通道,突出有效位置,抑制无效位置,从而提高准确率。

-

文中选取“大疆 御 Mavic 2”、“大疆 御Mavic Air”无人机以及一种自制四旋翼无人机作为研究对象,通过可见光相机与转台集成的实验设备采集无人机原始图片。同时考虑无人机飞行空域的实际情况,文中从加利福尼亚理工学院鸟类数据库-2011(Caltech-UCSD-Birds-200-2011)[8]中选取部分鸟类图片作为图像数据集的负样本。由于拍摄的无人机原始图片的像素尺寸不规则,为了使其能够输入卷积神经网络,还需要对这些原始图片做图像预处理操作,图像预处理效果如图1所示。通过灰度处理、边缘检测、图像滤波、图像增强和图像形态学处理等一系列图像处理方法检测原始图片中的无人机轮廓并裁剪出来;再通过尺寸归一化操作统一裁剪图片的像素尺寸,由于文中使用迁移学习方法迁移在ImageNet数据集上学习好的网络预训练参数,因此需要将裁剪图片的像素尺寸修改为224×224 pixel,使无人机图片像素尺寸与预训练网络的输入图片像素尺寸一致;最后通过旋转、翻转以及添加噪声等图像扩增方式扩充无人机图像数据集,防止网络出现过拟合现象。

为了更符合实际情况,除了蓝天白云等简单背景外,还获取包括楼房、树木、操场等复杂背景下的无人机图片,部分图片展示如图2所示。

-

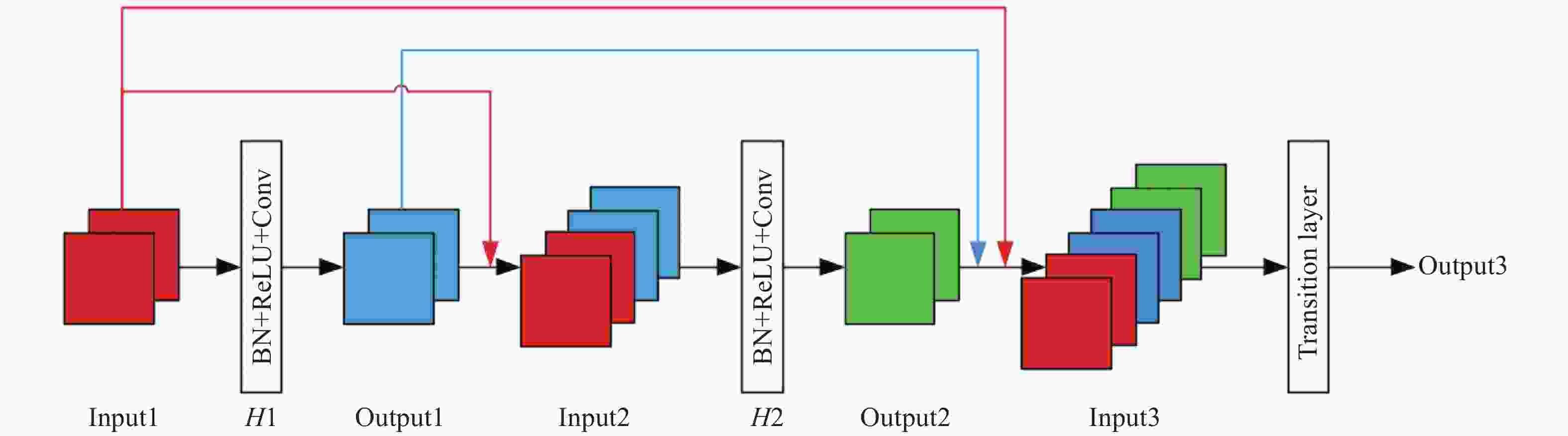

文中建立的无人机样本属于小样本,特征提取相对较少,识别准确率不够高。密集卷积网络(DenseNet)[9]具有密集块(Dense Block),结构见图3,该结构使密集块中的每个卷积层均直接与前面层相连,这样每个层的输入会接收前面所有层的输出作为额外输入,所有的输入特征图通过通道级联的方式沿通道方向进行拼接,使每个层输入的特征图更多,具有更多的图像特征,实现了特征的重复使用[10],提高了网络的计算效率,相对增多了特征的提取。密集块的具体实现为:

$$ {x_l} = H([{x_0},{x_1},\cdots,{x_{l - 1}}]) $$ (1) 式中:xl表示密集块中第l层输出的特征图;x0, x1, ···, xl−1分别表示原始输入、第1层输出以及第l−1层输出的特征图;H(·)表示在第l层中进行的一系列非线性变换,在密集块中H(·)由BN+ReLU+1×1 Conv+BN+ ReLU+3×3 Conv组成。

迁移学习(Transfer Learning)能够将在大型数据集ImageNet上学习到的图像分类知识应用于不同但相关的图像分类任务中。迁移学习的网络与训练随机初始化的新网络相比速度更快、构建更容易,节省训练时间;而且迁移学习的网络已经学习到足够丰富的图像特征,与训练随机初始化的新网络相比识别准确率更高;同时迁移学习的网络不需要大量的数据进行训练,解决了目标领域中仅有少量样本的学习问题[11-13]。

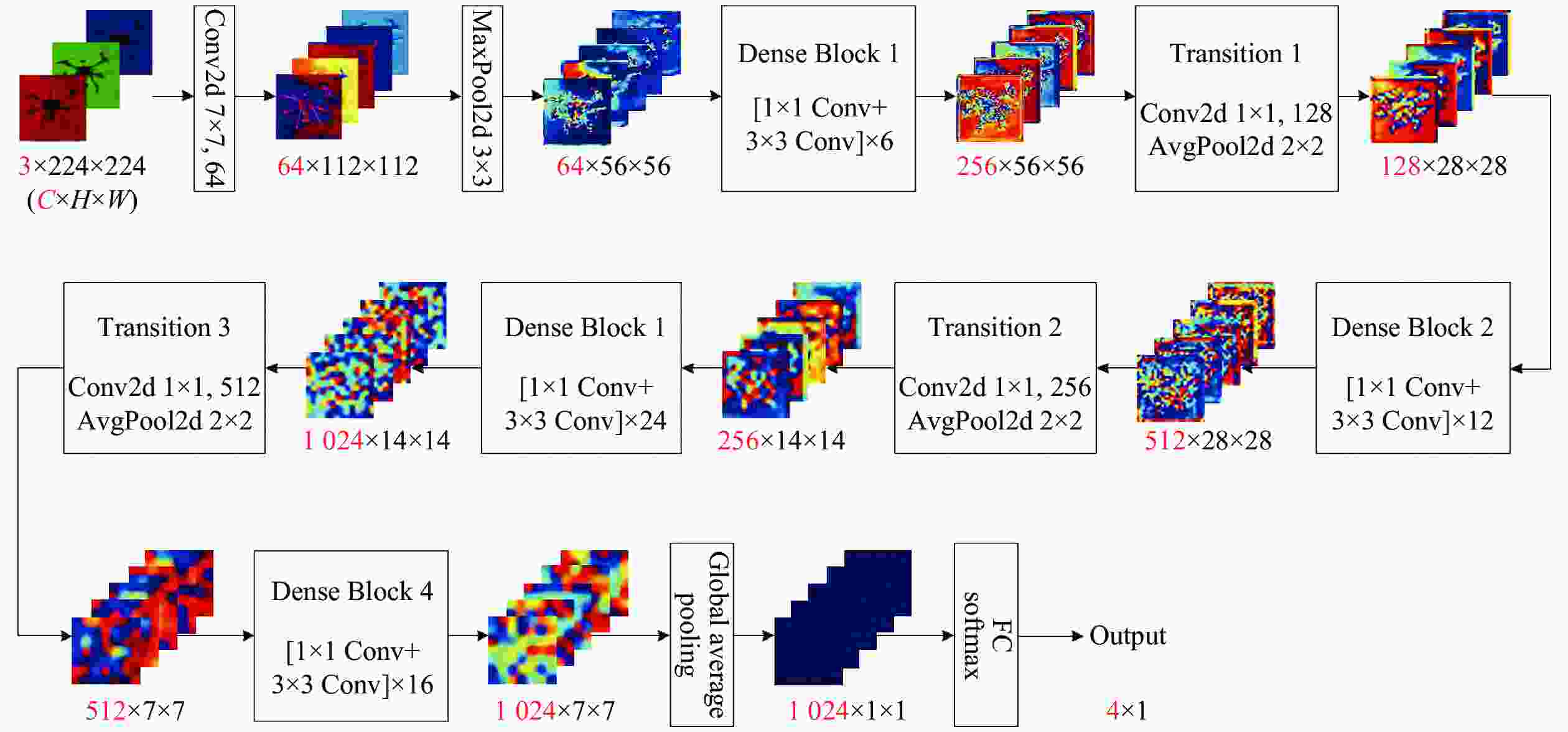

文中设计的基于迁移学习的密集卷积网络为TL-DenseNet-121,其结构和各层输出结果如图4所示。其中每个特征图下方均标注了特征图的尺寸,即通道数C×高度H×宽度W,特征图通道数C用红色标注。输入的无人机图片在RGB颜色空间下的通道数为3,经过TL-DenseNet-121网络中的一系列卷积层、池化层以及4个Dense Block的特征提取和特征拼接后,输入进全局平均池化层(Global Average Pooling)的特征图由3通道变为1024通道。通道数的增加证明了TL-DenseNet-121可以在无人机图像数据集样本数量较少的情况下增加提取到的图像特征,使后续的识别分类结果更准确。

-

注意力机制(Attention Mechanism)是一种通过模仿人脑来实现从大量输入信息中重点处理有用信息并忽略无关信息的机制[14],通过突出模型中对机器学习任务有益的特征信息实现模型的优化。目前,注意力机制已被广泛应用于图像、语音及文本识别等深度学习任务中[15]。例如,Liu等通过使用具有注意力机制和卷积层的双向LSTM实现文本分类任务[16];张宇等通过使用注意力机制对输入层不同时刻的语音特征进行加权,从而提高文中设计的基于多任务学习框架的LSTM声学模型识别远场语音的准确率 [17]。因此,文中对基于迁移学习的密集卷积网络TL-DenseNet-121进行改进,在网络中加入不同的注意力机制模块,使网络识别无人机图像数据集的准确率更高。

-

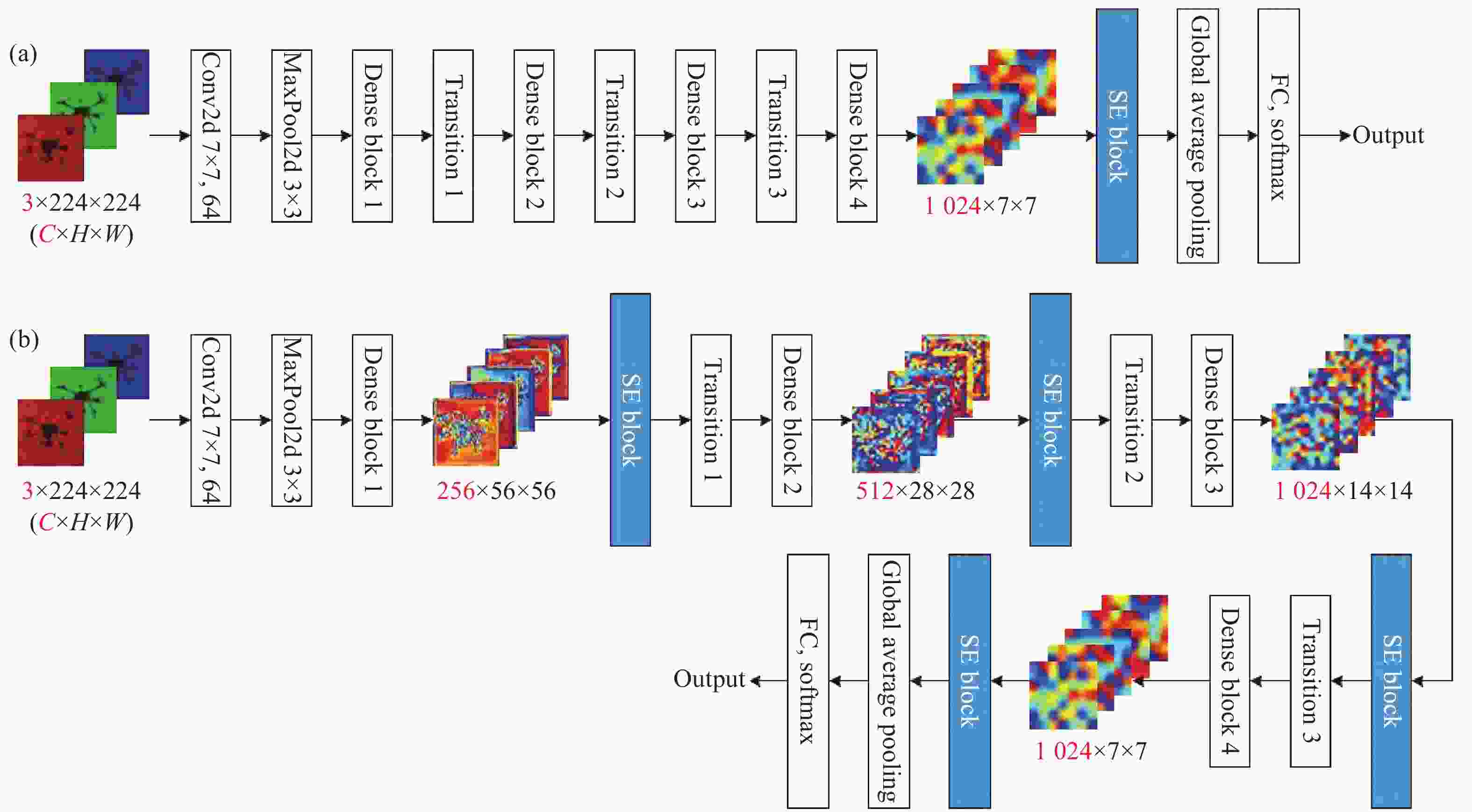

由于密集卷积网络采用通道级联方式沿深度方向增加了特征图的通道数,增加了特征提取,提取了更多的特征,但是同时也增加了无效的通道,必须要去除。根据图3可以看出,不断地进行通道级联会使密集块之后的过渡层(Transition Layer)的输入特征图通道数达到当前密集块中所有特征图通道数的最大值,每个过渡层输入的特征图通道数分别为256、512、1024和1024。因此文中设计了基于通道注意力机制融合的密集卷积网络TL-SE1-DenseNet-121和TL-SE4-DenseNet-121。它们是在TL-DenseNet-121网络中加入通道注意力机制SE Block来降低冗余通道对特征提取以及网络识别产生的不好影响,使提取的特征更为准确。

通道注意力模块SE Block[18]的结构如图5(a)所示,该模块主要包含压缩(Squeeze)和激励(Excitation)两部分。其中Squeeze操作通过一个全局平均池化将输入特征图C×H×W压缩为C×1×1;Excitation操作通过全连接层和激活函数生成通道权重;最后通过Scale操作将通道权重与特征图对应通道的二维矩阵相乘,实现通道加权操作。

图 5 不同注意力机制模块。 (a) SE Block; (b) CA Block

Figure 5. Different attention mechanism modules. (a) SE Block; (b) CA Block

文中为了对比融合不同个数和位置通道注意力模块的网络识别效果,设计了融合不同个数和不同位置通道注意力模块的密集卷积网络。分别为融合一个SE Block的网络TL-SE1-DenseNet-121和融合四个SE Block的网络TL-SE4-DenseNet-121。其结构图如图6所示。图中,SE Block用蓝色标出,它的位置和个数明显可见。融合不同个数和位置的SE Block将会对网络的识别效果造成不同影响,在后面的实验体现。

-

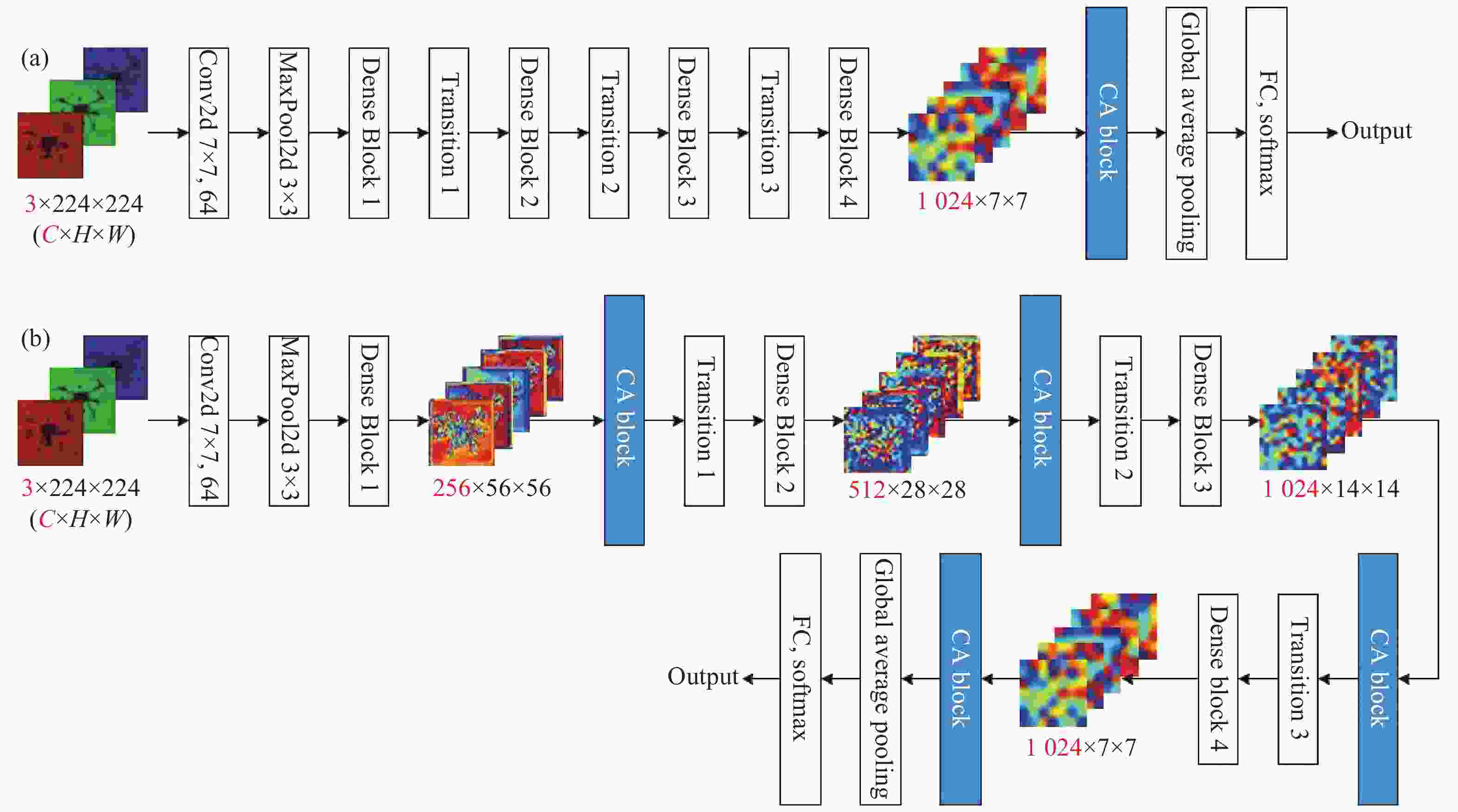

为了减少运用密集卷积网络带来的无效通道的问题,并且能够使识别准确率更高,文中设计了融合坐标注意力模块的密集卷积网络TL-CA1-DenseNet-121和TL-CA4-DenseNet-121。它们不仅能降低冗余通道对特征提取以及网络识别产生的不好影响,还能关注空间信息,提高识别准确率。坐标注意力模块CA Block[19]的结构如图5(b)所示,它不仅考虑了特征通道之间的关系,同时还考虑了特征的空间位置信息,注意的特征信息更为全面。该模块包括了Coordinate信息嵌入以及Coordinate Attention生成两个步骤。其中Coordinate信息嵌入操作通过使用尺寸为(H, 1)和(1, W)的池化核分别沿水平坐标以及垂直坐标对特征图进行编码,该方法可以避免SE Block中Squeeze操作将全局空间信息压缩至通道描述符从而难以保存位置信息的问题;Coordinate Attention生成操作通过Concatenate操作将不同方向感知的特征图融合,使用卷积变换改变特征图通道数,之后将特征图沿空间维数分解为两个单独的张量,最后通过卷积变换以及激活函数生成两个权重,将两个权重与原特征图相乘实现加权操作。

文中为了对比融合不同个数和位置坐标注意力模块的网络识别效果,设计了融合不同个数和不同位置坐标注意力模块的密集卷积网络。分别为融合一个CA Block的网络TL-CA1-DenseNet-121和融合四个CA Block的网络TL-CA4-DenseNet-121。其结构图如图7所示。如图所示CA Block用蓝色标出,它的位置和个数明显可见。不同的识别效果在实验部分体现。

-

笔者课题组设计的反无人机系统是针对广场、公园等公共场合,在1000 m范围内识别无人机。无人机图像采集在学校的广场进行,如图8所示,采集1000 m范围内的各种背景下的图片。包括纯天空的背景、有楼的背景、有树的背景。采集的无人机图片经过图像预处理后组成实验所需的图像数据集,无人机图像数据集分布如表1所示。实验中这些图片按照7∶3的比例划分为训练集和验证集。

表 1 无人机图像数据集分布情况

Table 1. Distribution of drone image dataset

Simple background Complex background DJI mavic 2 1256 960 DJI mavic air 1088 960 Homemade Quad-Rotor drone 976 624 Caltech-UCSD-Birds-200-2011 2400 Total 8264 -

文中的硬件环境为Windows 10系统;Intel(R) Core(TM) i9-10900 F CPU @ 2.80 GHz 2.81 GHz,32 G RAM;NVIDIA GeForce RTX 2060 GPU,6 G显存;软件环境为Python 3.7、Sublime、PyCharm;使用的深度学习框架为Pytorch。

-

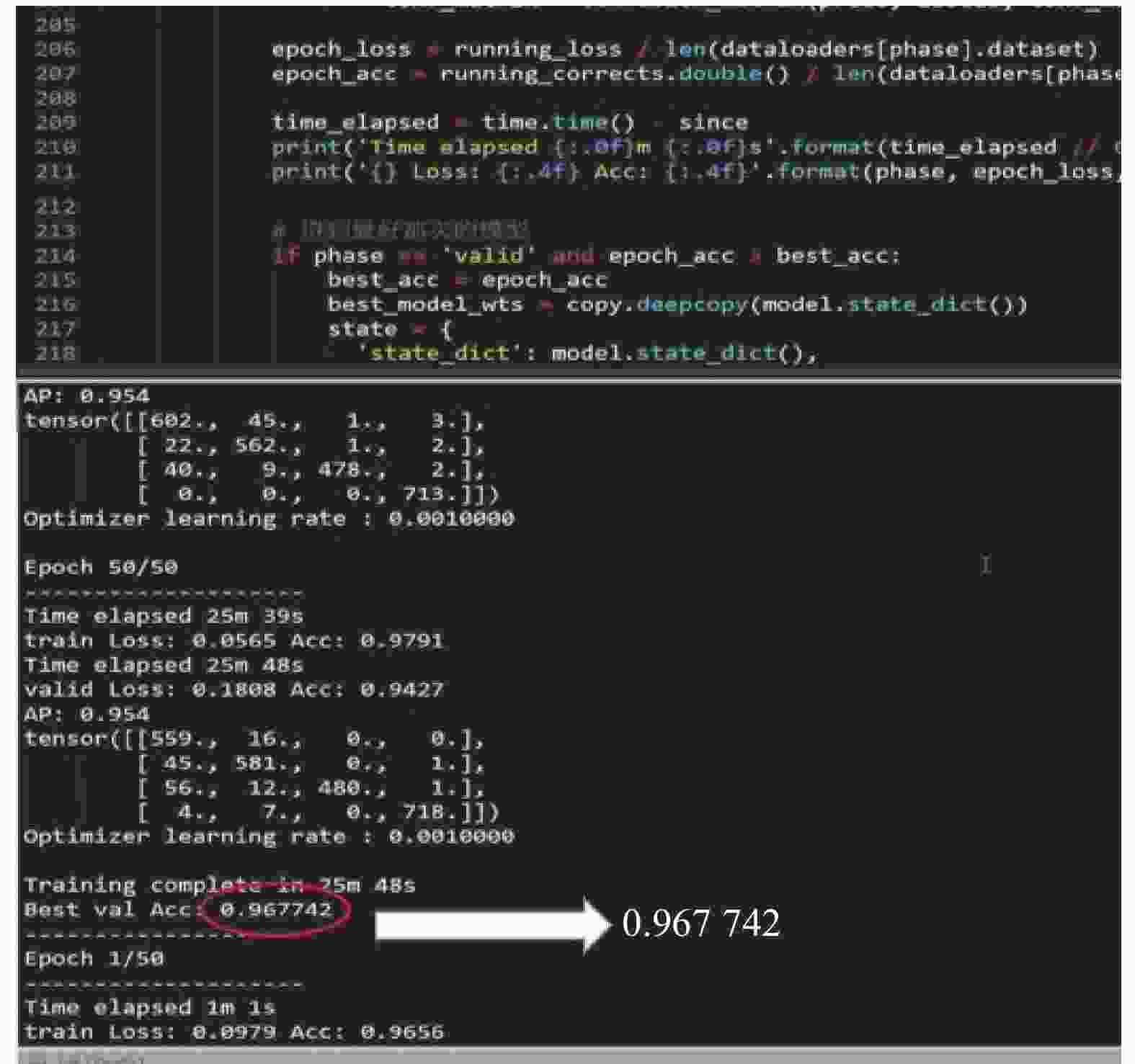

文中使用TL-DenseNet-121网络对无人机图像数据集进行识别实验。实验首先对网络中自定义的全连接层参数进行初始训练,实验过程中将每批次训练样本数量大小batch size设置为16、历元数epoch设置为50。经过50个epoch的初始训练后得到TL-DenseNet-121,识别结果如图9所示。

选取初始训练中验证集准确率最高的epoch所对应的模型参数并保存,根据图9可知,此时TL-DenseNet-121在验证集上的最高准确率为96.77%。

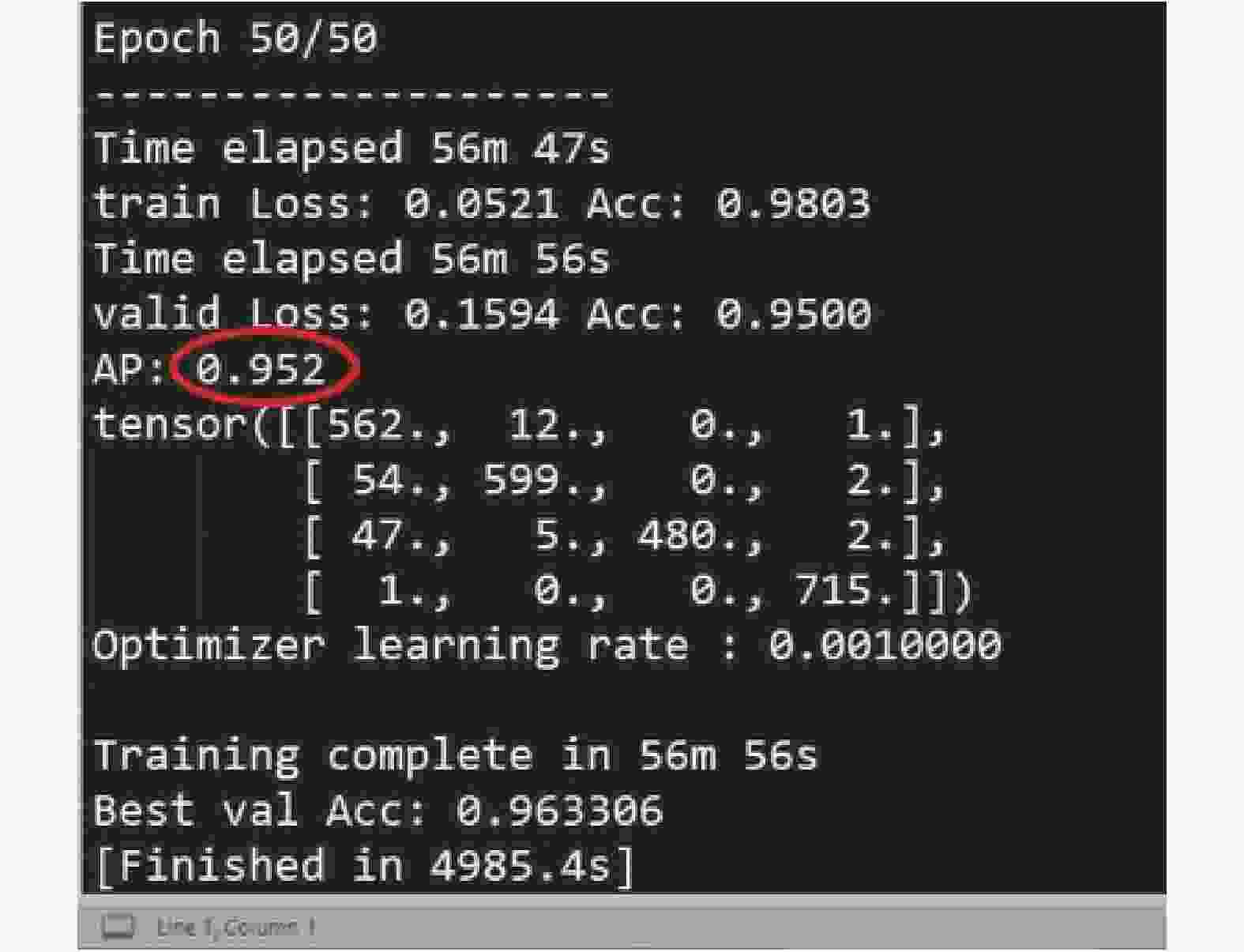

调用初始训练保存的网络模型,在此基础上对网络中的所有卷积层和全连接层参数做全训练,网络超参数设置与初始训练相同。经过50个epoch的全训练后得到TL-DenseNet-121的识别结果如图10所示。实验选取全训练中50个epoch的验证集平均准确率以及网络训练时间作为评价指标,根据图10可知,此时TL-DenseNet-121的验证集平均准确率为95.24%、网络训练时间为4985 s。

为了充分说明模型识别无人机图像数据集的效果,实验还获取了TL-DenseNet-121网络在全训练中验证集准确率最高时的混淆矩阵,混淆矩阵如公式(2)所示,此时的验证集准确率为96.33%。混淆矩阵在对角线上的值越大,表明模型的分类效果越好[20]。

$$ {\text{Confusion Matrix = }}\left[ {\begin{array}{*{20}{c}} {613}&{33}&1&1 \\ {25}&{581}&2&1 \\ {26}&2&{477}&0 \\ 0&0&0&{718} \end{array}} \right] $$ (2) 通过混淆矩阵可以计算出模型的精确率(Precision)和召回率(Recall),再根据这两个参数可以计算出F1-Score,F1-Score综合了精确率和召回率的结果,它是评价分类模型的重要指标。其取值范围为[0, 1],值越大代表网络输出结果越好。计算公式如下所示:

$$ {\text{Precision = }}\frac{{{\text{TP}}}}{{{\text{TP + FP}}}} $$ (3) $$ {\text{Recall = }}\frac{{{\text{TP}}}}{{{\text{TP + FN}}}} $$ (4) $$ {\text{F1 - Score = }}\frac{{{\text{2}} \times {\text{Precision}} \times {\text{Recall}}}}{{{\text{Precision + Recall}}}} $$ (5) 式中:TP表示预测为正的正样本;FP表示预测为正的负样本;FN表示预测为负的正样本。

以“大疆御 Mavic 2”为例计算该情况下的F1-Score,将四分类问题合并为二分类问题可得此时TP=613、FP=35、FN=51,将数据代入公式(3)~(5)可得F1-Score为0.9345,结果表明TL-DenseNet-121能够识别构建的无人机图像数据集。

为了验证迁移学习方法对网络识别效果以及训练速度的影响,文中还使用未使用迁移学习的训练初始化的DenseNet-121网络对无人机图像数据集进行识别实验。实验过程中将每批次训练样本数量大小batch size设置为16,同时为了对应TL-DenseNet-121网络的初始训练和全训练次数,将历元数epoch设置为100。经过100个epoch的训练后得到DenseNet-121的识别结果如图11所示。实验选取训练中100个epoch的验证集平均准确率以及网络训练时间作为评价指标,根据图11可知此时DenseNet-121的验证集平均准确率为87.64%、网络训练时间为7258 s。

根据DenseNet-121网络在训练中验证集准确率最高时的混淆矩阵可以计算出此时DenseNet-121网络的F1-Score为0.8793。通过对比DenseNet-121和TL-DenseNet-121网络识别无人机图像数据集的实验结果可知:(1) 识别平均准确率和F1-Score的不同是因为TL-DenseNet-121网络迁移了在大型数据集ImageNet上已经学习好的先验知识,因此在识别不同但相关的图像分类任务时,网络识别效果要优于训练初始化的DenseNet-121网络;(2) 网络训练时间不同是因为TL-DenseNet-121网络使用初始训练和全训练相结合的训练策略,在初始训练中仅对自定义的全连接层参数进行训练。而训练初始化的DenseNet-121网络需要始终对网络中的所有参数进行训练。因此TL-DenseNet-121网络的训练时间要比DenseNet-121网络短。

通过以上对比结果证明了迁移学习网络的快速性和准确性。

-

文中融合不同个数、不同位置、不同注意力机制模块的多个网络对无人机图像数据集进行识别实验。训练策略和超参数设置均与TL-DenseNet-121一致。经过50个epoch的初始训练和50个epoch的全训练后,取识别准确率最高的TL-CA4-DenseNet-121的识别结果如图12所示。

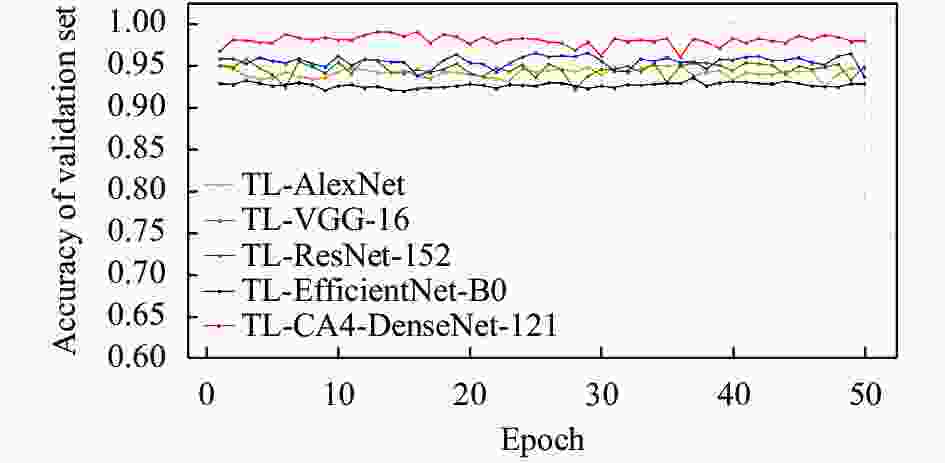

取多个网络在全训练中验证集的准确率曲线与TL-DenseNet-121进行对比,绘制对比曲线如图13所示。

图 13 多种网络的对比曲线。 (a) 加入SE Block的网络对比曲线; (b) 加入CA Block的网络对比曲线

Figure 13. Comparison curves of various networks. (a) Network comparison curves introduced by SE Block; (b) Network comparison curves introduced by CA Block

为直观反映各网络的识别效果,以验证集的平均准确率、F1-Score以及网络训练时间作为评价指标对实验数据进行整理,实验数据对比结果如表2所示。

表 2 不同网络的对比结果

Table 2. Comparison results of different networks

Average accuracy F1-Score Training time/s TL-DenseNet-121 95.24% 0.9345 4985 TL-SE1-DenseNet-121 95.85% 0.9375 4984 TL-SE4-DenseNet-121 96.84% 0.9686 6362 TL-CA1-DenseNet-121 95.70% 0.9490 5602 TL-CA4-DenseNet-121 97.93% 0.9826 6832 对比表2中的实验数据可知:(1) 无论是加入SE Block的TL-SE1-DenseNet-121、TL-SE4-DenseNet-121网络,还是加入CA Block的TL-CA1-DenseNet-121、TL-CA4-DenseNet-121网络,它们的识别平均准确率和F1-Score均高于未加入注意力机制的TL-DenseNet-121网络。但是由于加入注意力机制会使网络参数的数量增加,这些增加的随机初始化的网络参数需要从头开始训练,因此加入注意力机制的网络训练时间要比未加入注意力机制的TL-DenseNet-121网络长。同时引入注意力机制模块的数量越多,网络的训练时间越长;(2) 在每个Dense Block之后分别加入注意力机制的网络的识别效果要高于只在Dense Block 4之后加入注意力机制的网络,其中引入CA Block的TL-CA4-DenseNet-121网络的识别平均准确率和F1-Score达到最高。

综合对比全部实验数据,文中选用识别效果最好的TL-CA4-DenseNet-121网络作为文中设计的反无人机系统图像识别算法。该网络识别无人机图像数据集的验证集平均准确率为97.93%,F1-Score为0.9826,网络训练时间为6832 s。

-

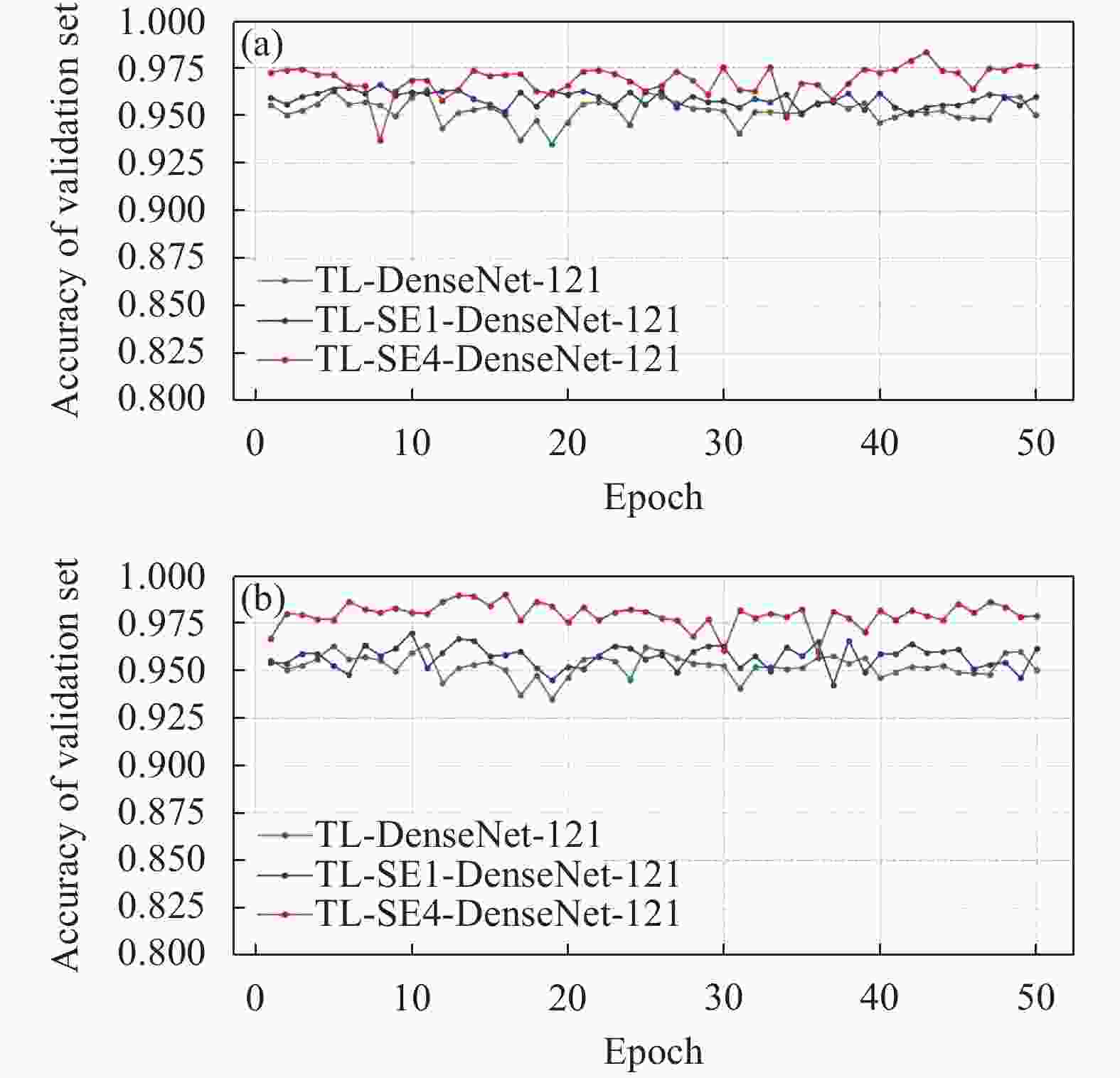

为了验证文中设计的TL-CA4-DenseNet-121网络识别无人机图像数据集的优越性和可行性,本节使用经典卷积神经网络模型AlexNet、VGG-16、ResNet-152和EfficientNet-B0对无人机图像数据集进行识别实验。训练策略和超参数设置均与TL-CA4-DenseNet-121一致。经过50个epoch的初始训练和50个epoch的全训练后,取多个网络在全训练中验证集的准确率曲线与TL-CA4-DenseNet-121进行对比,绘制对比曲线如图14所示。

为直观反映各模型的识别效果,以验证集的平均准确率、F1-Score以及网络的训练时间作为评价指标对实验数据进行整理,实验数据对比结果如表3所示。

表 3 多模型的对比结果

Table 3. Comparison results of different models

Average accuracy F1-Score Training time/s TL-AlexNet 94.06% 0.9151 1219 TL-VGG-16 94.49% 0.9244 6002 TL-ResNet-152 95.42% 0.9345 9023 TL-EfficientNet-B0 92.59% 0.8853 3388 TL-CA4-DenseNet-121 97.93% 0.9826 6832 对比表3中的实验数据可知:(1) 与其他经典卷积神经网络模型相比,TL-CA4-DenseNet-121网络的参数数量较多,因此TL-CA4-DenseNet-121网络的训练时间长于其他对比网络模型;(2) 由于TL-CA4-DenseNet-121网络加入多个坐标注意力模块,使特征图中的通道信息和位置信息更为突出,因此TL-CA4-DenseNet-121网络的平均准确率和F1-Score高于其他对比网络模型。

通过以上对比结果证明了文中设计的TL-CA4-DenseNet-121网络识别无人机图像数据集的优越性和可行性。

-

(1) 为了解决无人机样本小、特征提取少的问题,以及提高反无人机系统中无人机图像识别的准确率,提出了一种基于迁移学习、密集卷积网络和坐标注意力机制融合的反无人机系统图像识别方法。此识别方法采用密集卷积网络增加了图像的特征提取;采用迁移学习方法提高网络的识别准确率;采用坐标注意力机制抑制无效通道,关注位置特征,提高网络的识别准确率。

(2) 运用自制设备建立无人机图像数据集。设计了针对小样本的基于迁移学习的密集卷积网络TL-DenseNet-121、设计了基于迁移学习的密集卷积网络分别和不同个数、不同位置、不同注意力机制融合的网络。针对设计的各种网络进行了识别对比实验,同时将识别效果最好的TL-CA4-DenseNet-121网络与经典卷积神经网络模型进行识别了对比实验。实验结果表明了基于迁移学习和坐标注意力机制的密集卷积网络的优越性和可行性。

Image recognition method of anti drone system based on coordinate attention mechanism

-

摘要: 反无人机系统是识别和打击“黑飞”无人机的有效手段,图像识别无人机是反无人机系统的关键之一。针对采集的无人机样本属于小样本、提取特征不够多,识别准确率不够高的问题,提出了一种基于迁移学习、密集卷积网络和坐标注意力机制融合的反无人机系统图像识别方法。首先,运用自制设备采集了多种无人机在不同背景下的图片,建立数据样本;其次,设计针对无人机小样本识别的基于迁移学习、坐标注意力机制和密集卷积网络融合的网络TL-CA4-DenseNet-121、基于通道注意力机制融合的网络TL-SE4-DenseNet-121等网络,运用设计的网络对小样本进行识别,并进行对比,然后分别进行了基于不同位置和不同个数的坐标注意力模块和通道注意力模块的网络识别实验;最后,将识别效果最优的网络与经典卷积神经网络模型进行对比实验。实验结果表明,提出的TL-CA4-DenseNet-121网络识别效果优于其他网络,识别的平均准确率为97.93%,F1-Score为0.9826,网络训练时间为6832 s。结果表明了该网络在识别小样本无人机方面的优越性和可行性。Abstract: Anti drone system is an effective way to identify and attack the "black flying" drone. Image recognition drone is one of the keys of anti drone system. Aiming at the problems that the samples collected from drones are small samples, the features are not enough and the recognition accuracy is not high enough, an image recognition method of anti drone system based on transfer learning, dense convolutional network and coordinate attention mechanism was proposed. Firstly, a variety of drone images in different backgrounds were collected by using self-made device, and data samples were set up; Secondly, the network TL-CA4-DenseNet-121 based on transfer learning, coordinate attention mechanism and dense convolutional network, the network TL-SE4-DenseNet-121 based on channel attention mechanism were designed to identify small samples. The designed network was used to identify small samples and compare. The network recognition experiment of coordinate attention module and channel attention module based on different positions and different numbers were carried out respectively; Finally, the network with the best recognition effect was compared with the classical convolutional neural network models. The experimental results show that the proposed TL-CA4-DenseNet-121 network has better recognition effect than other networks, and the average accuracy of recognition is 97.93%, F1-Score is 0.9826 and training time is 6832 s. It shows the superiority and feasibility of this network in identifying small sample drones.

-

Key words:

- drone /

- image recognition /

- coordinate attention mechanism /

- dense convolutional network

-

表 1 无人机图像数据集分布情况

Table 1. Distribution of drone image dataset

Simple background Complex background DJI mavic 2 1256 960 DJI mavic air 1088 960 Homemade Quad-Rotor drone 976 624 Caltech-UCSD-Birds-200-2011 2400 Total 8264 表 2 不同网络的对比结果

Table 2. Comparison results of different networks

Average accuracy F1-Score Training time/s TL-DenseNet-121 95.24% 0.9345 4985 TL-SE1-DenseNet-121 95.85% 0.9375 4984 TL-SE4-DenseNet-121 96.84% 0.9686 6362 TL-CA1-DenseNet-121 95.70% 0.9490 5602 TL-CA4-DenseNet-121 97.93% 0.9826 6832 表 3 多模型的对比结果

Table 3. Comparison results of different models

Average accuracy F1-Score Training time/s TL-AlexNet 94.06% 0.9151 1219 TL-VGG-16 94.49% 0.9244 6002 TL-ResNet-152 95.42% 0.9345 9023 TL-EfficientNet-B0 92.59% 0.8853 3388 TL-CA4-DenseNet-121 97.93% 0.9826 6832 -

[1] Zhu Mengzhen, Chen Xia, Liu Xu, et al. Situation and key technology of tactical laser anti-UAV [J]. Infrared and Laser Engineering, 2021, 50(7): 20200230. (in Chinese) [2] Xue Shan, Zhang Zhen, Lv Qiongying, et al. Image recognition method of anti UAV system based on convolutional neural network [J]. Infrared and Laser Engineering, 2020, 49(7): 20200154. (in Chinese) [3] Krizhevsky A, Sutskever I, Hinton G. Imagenet classification with deep convolutional neural networks [J]. Advances in Neural Information Processing Systems, 2012, 25: 1097-1105. [4] Szegedy C, Liu Wei, Jia Yangqing, et al. Going deeper with convolutions[C]//IEEE Computer Society, 2014. [5] Simonyan K, Zisserman A. Very deep convolutional networks for large-scale image recognition [J]. arXiv, 2014: 1409.1556. [6] He Kaiming, Zhang Xiangyu, Ren Shaoqing, et al. Deep residual learning for image recognition [C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 2016: 770-778. [7] Zheng Yili, Zhang Lu. Plant leaf image recognition method based on transfer learning with convolutional neural networks [J]. Transactions of the Chinese Society for Agricultural Machinery, 2018, 49(S1): 354-359. (in Chinese) [8] Wah C, Branson S, Welinder P, et al. The Caltech-UCSD birds-200-2011 dataset[C]//Computation & Neural Systems Technical Report, CNS-TR, 2011: 001. [9] Huang Gao, Liu Zhuang, Laurens V, et al. Densely connected convolutional networks[C]//IEEE Computer Society. IEEE Computer Society, 2016. [10] Zhu Siqi, Wang Jue, Cai Yufang. Low-dose CT denoising algorithm based on improved CycleGAN [J]. Acta Optica Sinica, 2020, 40(22): 2210002. (in Chinese) [11] Zhuang Fuzhen, Luo Ping, He Qing, et al. Survey on transfer learning research [J]. Journal of Software, 2015, 26(1): 26-39. (in Chinese) [12] Zhang Ruiqing, Li Zhangwei, Hao Jianjun, et al. Image recognition of peanut pod grades based on transfer learning with convolutional neural network [J]. Transactions of the Chinese Society of Agricultural Engineering, 2020, 36(23): 171-180. (in Chinese) [13] Gong Renjie, Zheng Zhihui, Cong Longjian, et al. Infrared target detection and recognition based on transfer learning with small samples [J]. Journal of Northwestern Polytechnical University, 2021, 39(S1): 84-88. (in Chinese) [14] Ren Huan, Wang Xuguang. Review of attention mechanism [J]. Journal of Computer Applications, 2021, 41(S1): 1-6. (in Chinese) doi: 10.11772/j.issn.1001-9081.2020101634 [15] Zhu Zhangli, Rao Yuan, Wu Yuan, et al. Research progress of attention mechanism in deep learning [J]. Journal of Chinese Information Processing, 2019, 33(6): 1-11. (in Chinese) [16] Liu Gang, Guo Jiabao. Bidirectional LSTM with attention mechanism and convolutional layer for text classification [J]. Neurocomputing, 2019, 337: 325-338. doi: 10.1016/j.neucom.2019.01.078 [17] Zhang Yu, Zhang Pengyuan, Yan Yonghong. Long short-term memory with attention and multitask learning for distant speech recognition [J]. Journal of Tsinghua University (Science and Technology), 2018, 58(3): 249-253. (in Chinese) [18] Hu Jie, Shen Li, Albanie S, et al. Squeeze-and-excitation networks [J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2020, 42(8): 2011-2023. doi: 10.1109/TPAMI.2019.2913372 [19] Hou Qibin, Zhou Daquan, Feng Jiashi. Coordinate attention for efficient mobile network design [C]//2021 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), 2021: 13708-13717. [20] Li Xiukun, Xu Tianyang, Ji Shoucong. Posture recognition of underwater target based on deep learning method [J]. Journal of Harbin Engineering University, 2021, 42(10): 1503-1509. (in Chinese) doi: 10.11990/jheu.202007107 -

下载:

下载: