-

随着我国制造产业的需求升级,激光跟踪仪在飞机、船舶等大型装备的精密装配、机器人末端执行器的绝对位姿控制等高精度在线测量应用中的作用越发突出。而断光、操作不当或其他现场偶发因素导致的跟踪中断,进而造成测量停止是影响激光跟踪仪工作效率最突出的问题。在激光跟踪仪发生跟踪中断后,为实现跟踪和测量的恢复,多数情况下是由操作人员手持合作目标靶球在一定空间范围内移动,寻找并对准空间中的激光束完成跟踪恢复;个别情况下需要操作人员将合作目标靶球放回激光跟踪仪的初始点,重新启动跟踪测量过程,这显著降低了工作效率。因此,实现激光跟踪仪的自主快速跟踪恢复是提高激光跟踪仪高效工作所必须解决的研究难题[1]。

近年来数字图像处理技术与机器视觉技术飞速发展,基于视觉成像系统及相关技术实现对激光测量系统的引导与再次对准成为该领域的研究热点。其中,天津大学研究了基于视觉引导的激光经纬仪动态跟踪与自动测量方法与系统装置,重点攻克了空间坐标转换与系统标定并实现了激光的自动对准[2-3];北京航空航天大学研究了视觉引导激光跟踪测量系统的空间坐标变换校准方法,给出了坐标系之间快速有效的解算方法[4],同时针对引导过程中靶球中心的定位方法进行了研究,实现从图像中提取靶球中心像素坐标位置[5-6]。上述方法多是利用数字图像处理与机器视觉技术针对激光成像光斑或合作目标靶球进行识别定位,通过坐标位置的换算引导激光指向目标位置,在一定程度上实现了自动对准,提高了测量效率。但其仍旧存在着较为明显的局限性,如应用现场环境复杂、形状相似干扰物造成的误识别,以及现场环境光线干扰、视觉成像系统观察角度和激光投射角度的变化等多种因素造成的合作目标无法识别等缺陷。中国科学院微电子研究所基于深度学习技术,利用改进的Faster R-CNN网络实现复杂场景下合作目标靶球的识别检测[1],但由于深层卷积神经网络的计算量较大,该方法需要在运算能力较强的GPU平台下进行,实时性方面仍旧不能满足工业现场的要求。

文中从实际应用需求出发,阐述了基于视觉系统的跟踪恢复原理。针对跟踪恢复实现过程中,复杂空间背景条件下合作目标靶球的快速准确识别这一核心问题,提出了基于主动红外视觉探测的方法并讨论该方法的优势,同时对系统组成、关键核心算法进行了详细设计和研究。最后构建了跟踪恢复实验装置系统,开展跟踪恢复功能检测实验,实验结果表明该方法能够实现激光跟踪仪的快速跟踪恢复。

-

基于视觉的激光跟踪仪跟踪恢复方法主要依靠图像信息计算合作目标靶球的偏移量,引导跟踪运动机构转动使激光束再次对准合作目标靶球完成跟踪恢复。

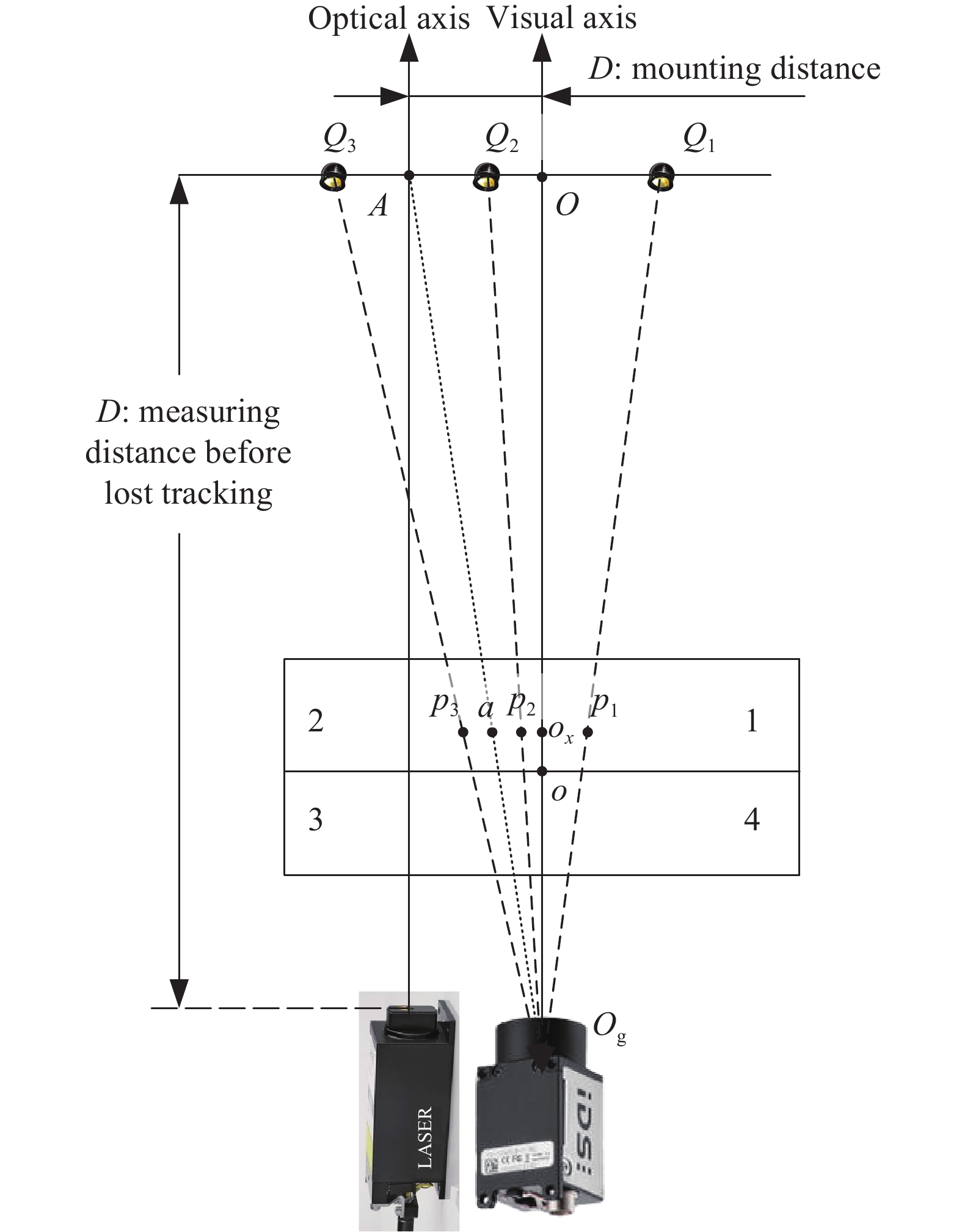

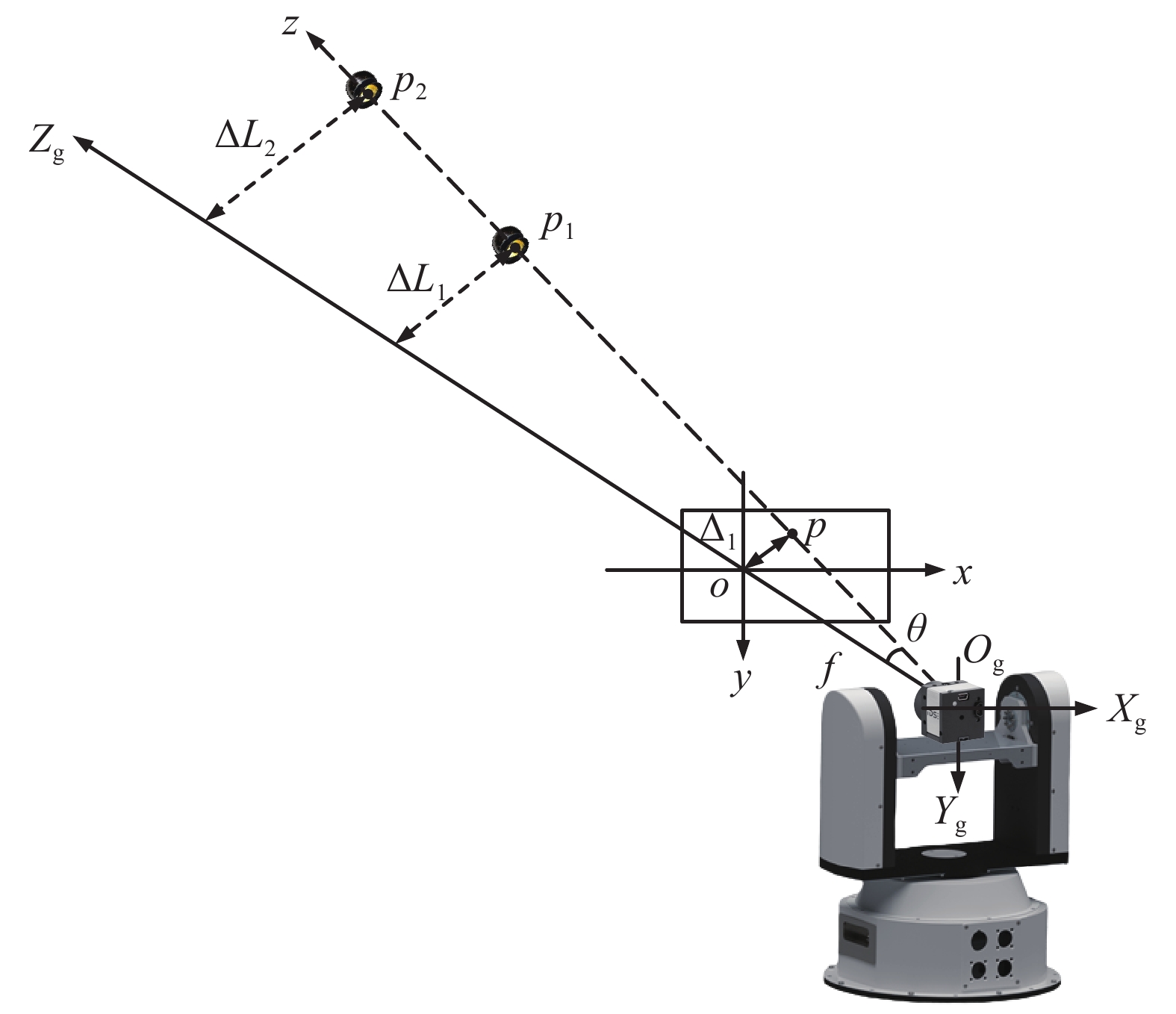

具体过程如图1所示,将相机作为激光跟踪仪光学部件之一安装在二维转台上,定义图中Og-XgYgZg为视觉成像系统的相机坐标系,其中O为相机光心,Zg为相机光轴,并假定激光的光轴与Zg

轴重合;o-xy为视觉成像系统中相机的图像坐标系,o点为图像坐标系中心点,图中略去激光测距系统。合作目标靶球在三维空间中移动,在正常跟踪测量工作状态下,合作目标靶球应在Zg 轴上;当发生跟踪中断、测量停止时,合作目标靶球偏离了激光光轴在图中P1点位置。为了实现跟踪恢复,需要引导跟踪运动机构转动θ角,使激光再次对准合作目标靶球。根据相机的小孔成像原理,靶球在图像中对应的中心像点为p。首先提取出图像中p点的像素坐标位置,并计算该点与图像中心点o之间的像素距离l,再利用提前标定出的相机内部参数换算为物理距离Δl。该距离在物空间上对应了合作目标靶球距离光轴Zg 的距离ΔL。从图1可见,根据相似三角形关系,可知: 式中:f为相机的焦距。为满足二维转台运动特性,θ角可分解为水平方向上的方位转动角θx和竖直方向上的俯仰运动角θy。其中θx由Δl的x轴分量计算得到,θy由Δl的y轴分量计算得到。根据摄像机成像原理及标定原理,利用公式(2)对θx和θy行计算,其中(x0,y0)、(xp,yp)是o点与p点的图像坐标;(u0,u0)、(up,up)是o点与p点的像素坐标;M为相机的内部参数,可通过标定获得。

需要注意的是,该方法与常见的视觉测量系统工作原理存在一定的不同,并不需要计算出合作目标靶球在空间中的具体三维坐标位置。根据相机小孔成像模型以及相机标定原理可知,图像中的成像点p对应物空间点不是唯一的,而是一条射线pz。如图1所示,当合作目标靶球工作在较远位置时发生跟踪中断,偏移位置点在p2,图像上对应的成像点仍旧为p点,跟踪恢复所需要的转动角θ与合作目标靶球在p1点时一样。此方法避免了复杂的空间坐标换算关系,在成像清晰的前提下,允许物空间点有一定的距离变化,一定程度上克服了传统视觉测量引导方法对拍摄距离的严格要求。

-

在系统实际装配过程中,能通过机械部件的微调解决相机视轴与激光光轴之间不平行的问题,但很难做到相机视轴与激光光轴同轴。相机与激光器是两个相对独立的部件,安装位置也存在一定的距离。实际的跟踪恢复不能以相机视轴为准,而要以激光的光轴为基准来计算转动角度值。要实现较为精准的跟踪恢复角度值计算,需要对非同轴偏差进行补偿。

设激光光轴与相机之间的水平安装距离为d,结合图2,这里仅在水平一个方向上进行分析,同理推导至竖直方向。跟踪中断发生后,靶球偏离激光光轴,根据其与视轴、光轴的空间位置关系可分为Q1,Q2,Q3三类,对应成像点是图像中的p1,p2,p3点。Q1、Q3分别代表了靶球位于视轴的右侧和光轴的左侧,Q2代表靶球正好位于视轴与光轴的中间位置。A点为靶球距离主题距离为D时,激光所对应的空间坐标点,该点对应理论像点为a。由于空间中并不存在反射面,因此该点a在实际成像过程中并不存在,仅用于计算过程。要实现跟踪恢复,就需要计算出p1,p2,p3点于a点之间相对的夹角α1,α2,α3。根据公式(1)可以计算出p1,p2,p3点与o点之间的夹角θ1,θ2,θ3 (这里θ角仅包含了水平分量)。a点与o点之间的夹角θa可按照如下公式计算:

式中:d为相机与激光器的安装距离;f为相机焦距。这两个值是系统内部结构参数值,不发生变化。变量D为A点距离跟踪仪主体的距离,该变量可以根据跟踪中断前最后的距离测量值得到。

由此,角α1,α2,α3计算见公式(4):

实际应用过程中为分辨运算符号的问题,将相机以中心o点划分为1~4共四个象限。对于x方向,当p点落在1、4象限时,角α的计算公式为:

当p点落在2、3象限时,角α的计算公式为:

通过识别靶球中心图像点在图片中坐标位置选用对应的公式计算跟踪恢复偏差角。

-

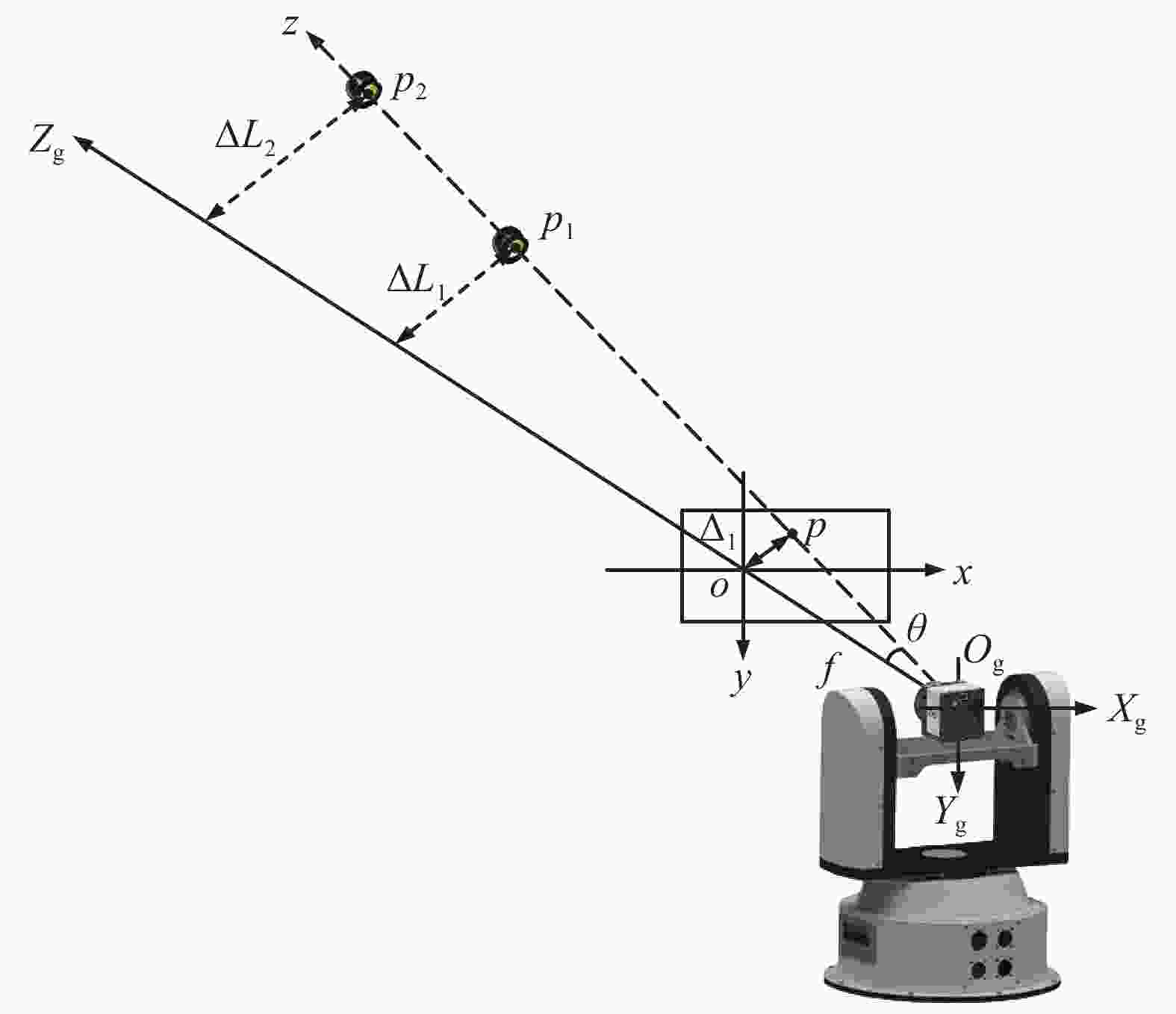

基于视觉系统引导的跟踪恢复中,难度最大的问题是如何在复杂背景下快速准确地识别定位出图像中的目标。基于传统图像处理与识别方法仅能在简单背景下实现合作目标靶球的检测,对于复杂背景、光照不均匀、目标姿态和尺度多变的适应性不强。基于深度学习实现的目标检测网络能够在一定程度上实现复杂背景下的目标检测定位[1],但由于其网络结构复杂、计算量较大,需要在较大型的计算平台上进行训练和推理,且其识别效果依赖数据集的构建,限制了该方法在实际工程中的集成应用。文中提出基于主动红外视觉探测系统的合作目标检测方法,如图3所示,发射与跟踪激光平行的大发散角大功率红外光束,覆盖合作目标靶球周边的大范围空间区域,利用合作目标形状规则且可对发射光进行强反射的特点,采用红外相机配合近红外带通滤光片对目标空间进行成像,在获取目标的成像信息的同时滤除可见光波段下的复杂背景干扰,通过加大目标与背景之间的对比度实现更加准确、可靠且快速的目标检测。

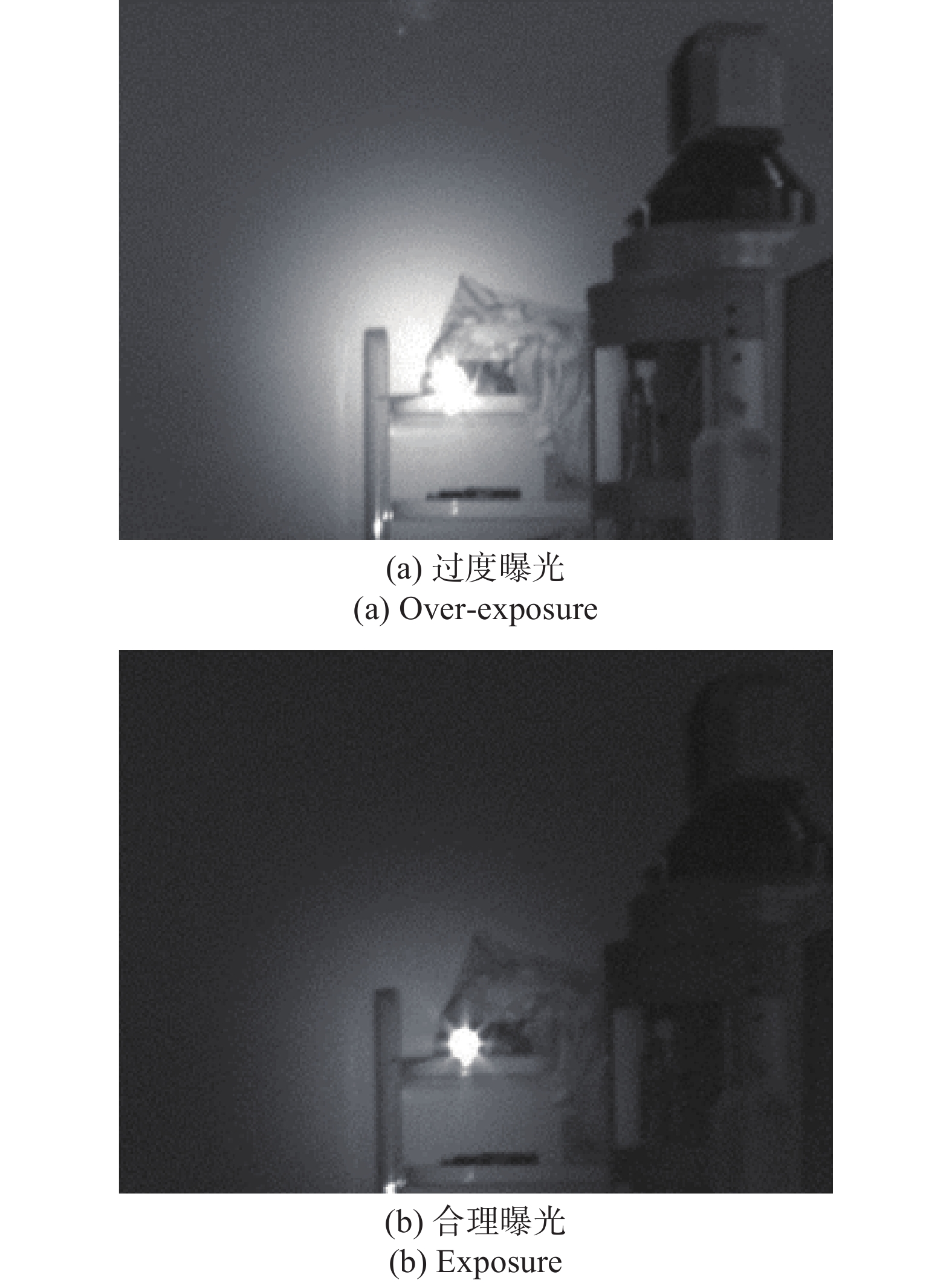

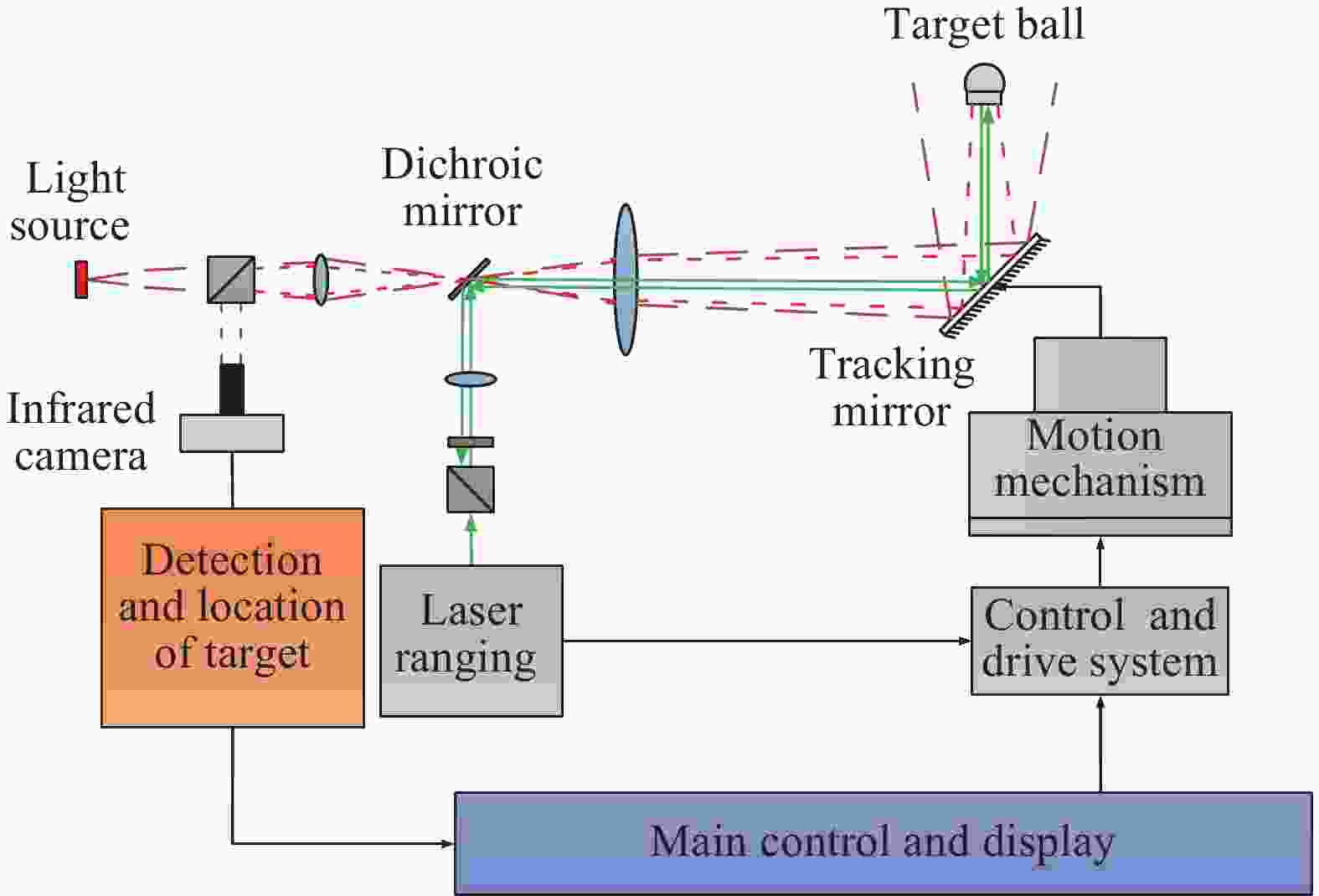

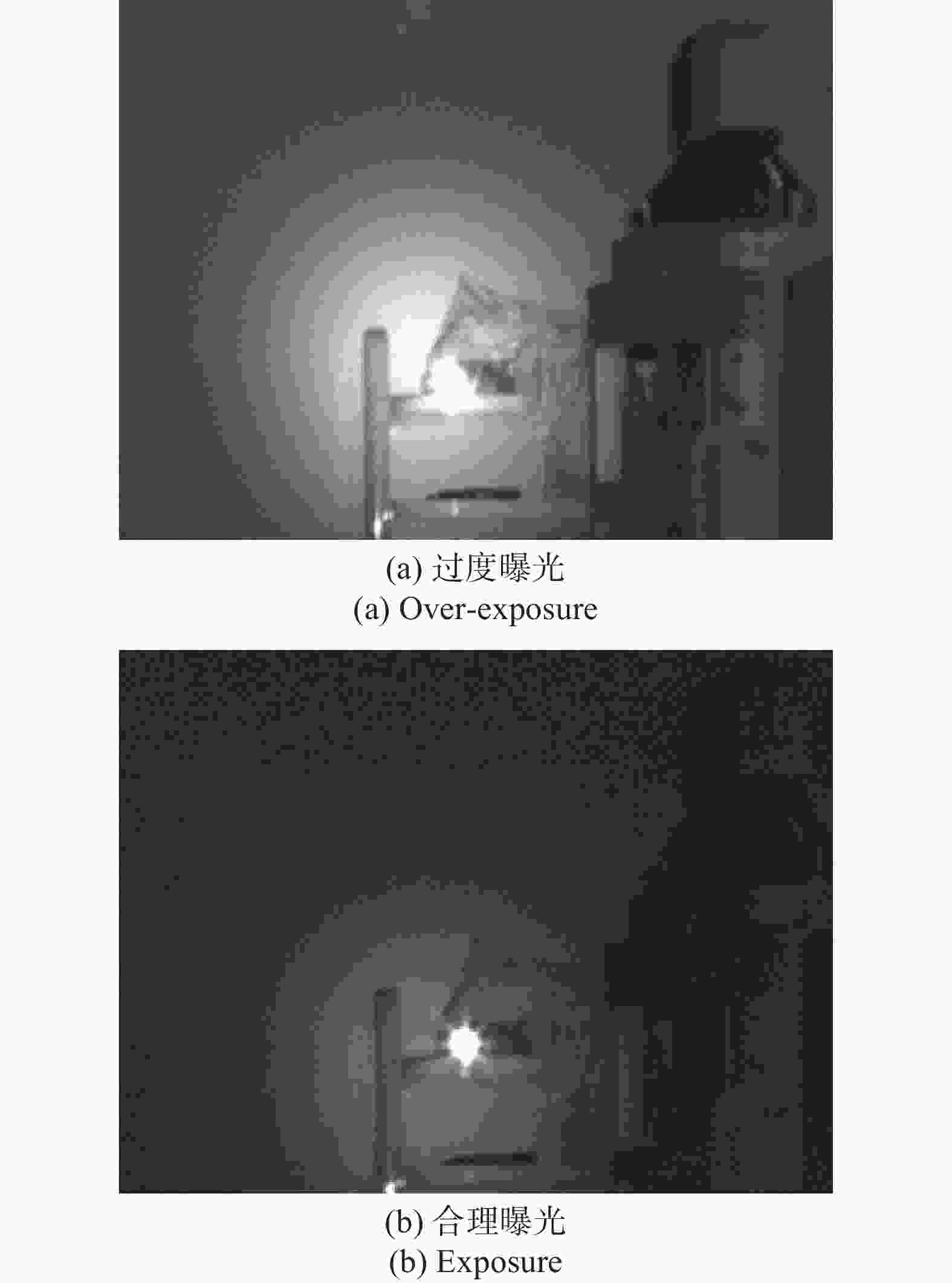

上述原理中,光源与红外相机是实现该方法的核心关键部件。文中选用近红外超辐射发光二极管(Superluminescent light emitting diodes, SLED)作为光源,其具有比半导体激光器更宽的发光光谱和更短的相干长度,同时具备比LED更高的输出功率,是一种宽光谱、弱时间相干性、大功率、高效率的半导体光发射器件。选用SLED作为光源,在保证高功率照明的前提下又不会对测距激光造成影响,是实现文中方法最优的空间照明光源。在红外图像传感器方面,选用集成了E2V公司的EV76C661ABT近红外增强CMOS图像传感器的红外相机,配合近红外带通滤光片滤除可见光波段的光线,通过调节相机传感器的曝光时间来适度减少背景物体的成像亮度,实现对复杂背景的滤除。如图4所示,图4(a)与4(b)为基于主动红外视觉探测系统所成的红外图像,其中图4(a)曝光时间比图4(b)的曝光时间长,该结果可以通过调整红外相机的CMOS图像传感器的曝光参数进行在线调节。从图4(b)中可以明显看到复杂的背景已经被滤除,而合作目标靶球所成的像是一个高亮的圆斑,大大提高了目标与背景之间的对比度,降低了从图像中提取目标像素位置的难度。此外,曝光时间的适度调节还可以实现对靶球工作距离的自适应,当靶球距离跟踪仪主体较近时,可减少曝光时间,反之则增大曝光时间使成像稳定。

-

合作目标靶球是一个体积小、特征少且外形简单的物体,其最大的特点是在强光源照射下,在图像中形成一个圆形的高亮斑,如图4所示。但激光跟踪仪是空间大尺寸高精度测量仪器,合作目标靶球所在的工作环境背景是复杂且多变的,文中在试验过程中发现背景中其他金属物体(如工件、其他仪器设备主体等)也会对SLED光源所发射的光线进行反射,在图像中形成高亮区域,该现象对正确识别定位红外图像中合作目标靶球的像素坐标位置产生一定不利影响。为解决这个问题,文中提出基于目标区域正圆度的特征值来对图像中的候选目标区域进行评分,最终将得分最高的区域的几何中心点作为合作目标靶球中心点所在的像素坐标位置。

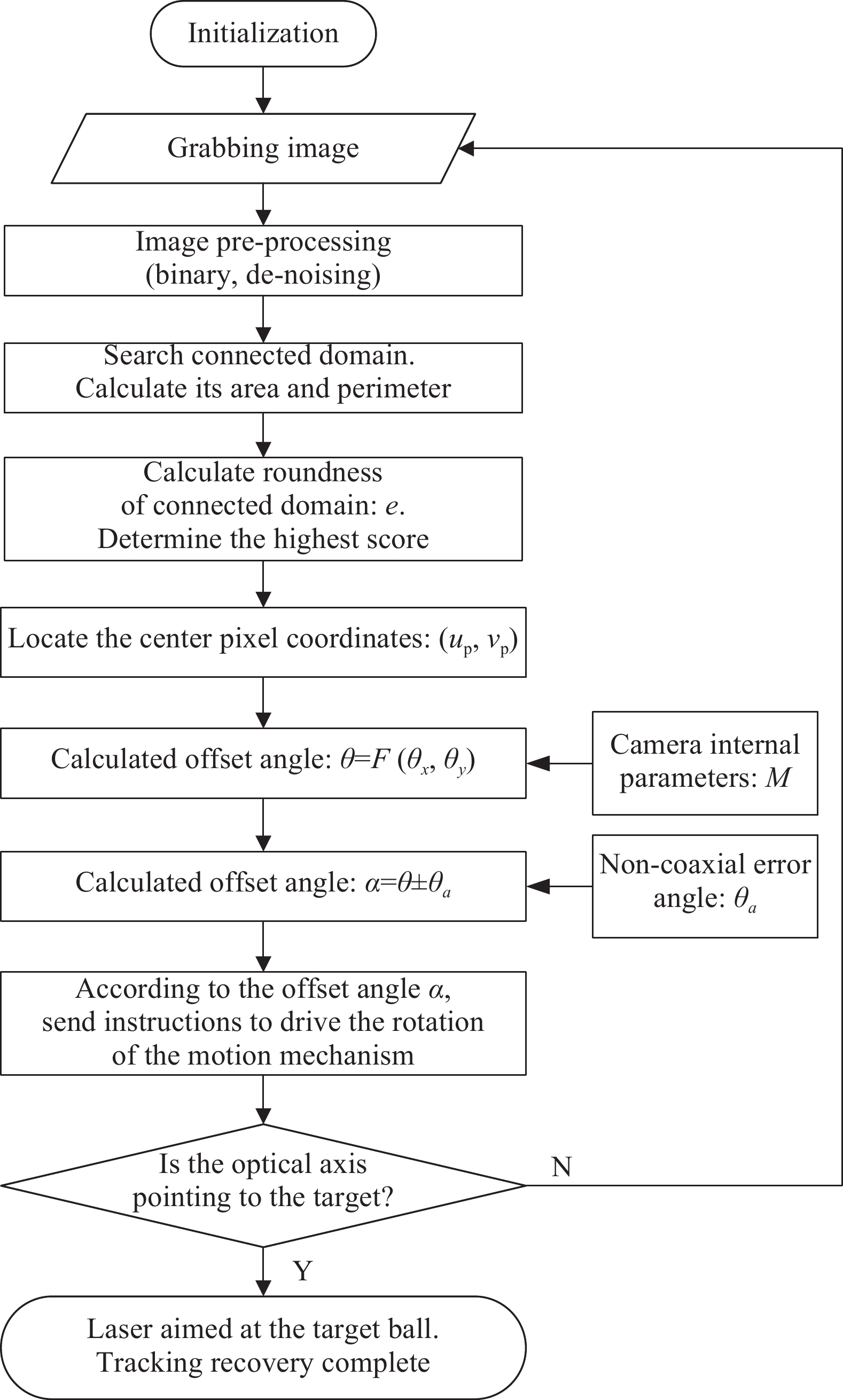

在进行特征值计算前,需要对输入的红外图像进行二值化、去噪、形态学操作等预处理[7-9]。首先对输入的灰度图像进行二值化,文中采用基于相机曝光参数加权的最大类间差二值化方(OSTU方法)。如图5(a)与图5(b)所示,首先用OSTU算法对输入图像计算出初始阈值t0,基于公式(7)计算出二值化阈值t:

式中:T为相机曝光时间;k为调整参数,可根据实验环境照明的强弱进行调整。针对二值图像,使用中值滤波、形态学开操作去除二值图像中像素面积较小的干扰块后,在使用闭操作将被切断的目标区域连接为一个整体。最后在图像中搜寻连通域作为候选目标区域。图5(c)中,有两个高亮的区域被选目标候选区域,一个是合作目标靶球。另一个是合作目标靶球附近的金属反光架。

-

理想情况下,经过图像预处理后的合作目标靶球的像应该是一个正圆形的亮斑。但由于实际工作状态下靶球往往距离相机和光源较远,且成像时由于操作人员的因素,其自身存在一定的姿态夹角,因此,实际的像应该是一个趋近于圆形的连通域,如图5(c)所示,背景中其他反光干扰物的像与圆形区别较大。因此,文中通过计算目标域的正圆度作为该目标域是否是合作目标靶球的像的主要判定依据。正圆度e的计算公式的定义如公式(8)所示:

式中:area为面积,是目标域中包含的像素数;perimeter为周长,是指目标域闭合的轮廓线上所有像素间的距离之和。由公式(1)可知,当目标区域越接近理想圆时,其面积越符合公式πr2,周长越符合2πr,则其正圆度e的计算越接近1,而与圆形区别较大的目标域的正圆度计算值则与1差别较大。

如图5(d)所示,图像中存在2个目标域,其中目标域No1的面积为331,周长约为68.52;目标域No2的面积为778,周长约为249.15;根据公式(8)计算各自的正圆度,可知e1约为0.887,e2约为0.157。经比较,目标域No1的正圆度更接近1,因此判定目标域1为合作目标靶球,将该目标域中心点的像素坐标(138,68)作为目标的定位(up,vp)的结果,如图5(e)所示,利用该结果计算转台的转动角度值θ,实现跟踪恢复。算法步骤如图6所示。

-

文中将实验划分为软件算法验证与系统功能验证两部分进行。软件算法验证实验主要在PC机环境下,利用软件测试方法对目标的快速识别与定位算法的速度与精度进行检测验证;在系统功能验证实验中,文中搭建了硬件验证实验平台,开展跟踪恢复功能检测实验,并对结果进行了分析。

-

为合理评估算法的性能,需要采集与实际工作情况相近的图像数据样本对算法进行评估。如图7所示,令操作员手持合作目标靶球在空间中移动,利用SLED照射目标区域,并用红外相机采集图像并保存。

文中共采集多个场景下共计约500张的多段连续视频图像数据用于检测,其中部分场景人为引入其他金属反光物作为背景干扰源。对于采集的数据首先利用LabelImg工具手工标注出合作目标靶球的边界框坐标位置,并将边界框几何中心点作为目标参考点位置(x0,y0),之后使用目标快速识别与定位算法对图像中的目标中心点进行定位,得到的结果记为(up,vp)。利用公式(9)计算目标点与参考点之间的像素坐标偏移量。

测试在windows 10环境下进行,PC机的CPU为Intel i7-6700HD;同时选用Visual Studio 2015编程环境,采用C++语言进行代码编程。经过测试,单张图像的检测速度在29~42 ms之间,平均每秒约28帧。表1展示了目标快速识别与定位算法的测试结果,其中98.6%的测试图像的检测结果与手工标注的参考点之间的误差不超过10个像素距离,验证了该算法能够实现图像中合作目标的快速准确识别定位。

Offset Percentage Processing time/ms 0-5 95.4% Minimax:29 5-10 3.2% Average:35.5 Above10 1.4% Maximum:42 Note: The test image resolution is 1280 ×1024. The average pixel area is about 621 pixels. According to the size of the minimum bounding rectangle of target,the evaluation criteria is 5 and 10 pixels Table 1. Test results of target recognition and position algorithm

-

文中利用二维运动转台为带载平台,搭建了一套跟踪恢复实验装置系统,如图8所示,目标靶球安装在一维运动导轨上,该导轨距离二维运动转台的直线距离为3 m,该导轨可根据实验需求对启停位置、运动速度等进行设置;红外相机与SLED光源的光纤发射端通过结构件安装在二维运动转台的负载平面上,红外相机选用定焦16 mm镜头;相机采集的图像数据通过USB接口传输至主控及显示系统中。主控系统利用目标快速识别与定位算法对输入图像进行处理后,根据其定位到的目标中心点像素坐标位置结果计算出跟踪恢复所需要的二维转台的转动角度值α。二维转台驱动箱与主控系统之间通过串口进行数据通信,驱动箱根据主控系统发送的转动角度、速度及加速度等各类指令信息来控制转台的运动。

进行跟踪恢复时,二维运动转台水平方向与竖直方向转动的原理方法一致,文中仅在水平一个方向上开展测试实验。实验以相机视轴替代激光光轴作为对准轴,规避了非同轴偏差角对实验的影响;当合作目标靶球与视轴未对准时,判定为目标丢失、跟踪中断需要启动跟踪恢复功能,通过二维转台带动红外相机转动,目标在图像中的成像位置也随之移动,当目标的图像中心点与图像中心像素坐标点重合时,判定为相机视轴对准了合作目标靶球,实现了跟踪恢复功能。

实验从跟踪恢复范围和跟踪恢复速度两个方面对跟踪恢复方法和系统性能进行评估。首先通过设定指令,令合作目标靶球与相机视轴在水平方向上对准,即在水平方向上目标靶球中心点像素坐标与图像中心点重合;之后用遮挡物遮蔽合作目标靶球。令一维运动导轨带动合作目标靶球运动至指定位置,移开遮蔽物,此时合作目标靶球在水平方向上相对于图像中心点已经产生了偏移,系统启动目标识别定位等跟踪恢复动作,统计系统完成跟踪恢复的全部时间。重复实验,设定相同的偏移距离,记录实验结果如表2所示。

Target

moving

distance/cmNumber of

experiments and

results/timesAverage time of

completion/sMotion number

of the

turntable/times5 30 Success:30 1.77 2 Failure:0 10 30 Success:30 1.81 2 Failure:0 15 30 Success:30 1.70 2 Failure:0 20 30 Success:30 1.82 2 Failure:0 25 30 Success:4 2.72 3 Failure:26 Table 2. Experimental results

由表2可以看出,当目标偏移距离小于25 cm时,系统能够稳定地实现跟踪恢复功能,而当目标偏移距离大于25 cm时,跟踪恢复失败的次数明显上升,这是由于合作目标靶球所在位置不在SLED光源覆盖范围内导致,该现象如图7所示。根据测算,实验中选用的SLED光源光束发散角约为9.5°,实验距离设置为3 m,光源理论有限覆盖范围约49.85 cm,单侧理论有效覆盖范围约24.92 cm。当目标距离初始点偏移距离为25 cm时,正处于光源有限覆盖范围的边缘,此时目标成像不稳定,无法有效地进行目标探测导致跟踪恢复失败。

在有效覆盖范围内,系统完成跟踪恢复的平均时间在1.7~1.8 s之间,明显低于图像单张35.5 ms的运算速度。除了常规的系统通信延时、转台运动耗时等因素外,造成该现象的主要原因是转台需要2次运动才能实现目标对准并完成跟踪恢复。在计算转动角度值α的过程中,目标中心点像素坐标定位的准确度是影响其精确度的重要原因,光照、目标姿态、目标与相机之间的相对位置、空间背景中的干扰等都是直接影响该坐标定位准确度的直接因素。在转台完成第一次运动后,合作目标靶球与相机之间的相对位置发生了变化,由于合作目标靶球是随着一维运动导轨在水平方向上运动,其反光面与相机的成像CCD之间始终存在一个会随着运动发生变化的夹角,反映在图像上就是目标在图像平面内发生了姿态转动;同时由于SLED光源随着相机发生了运动,因此目标所受到的光源照射角度也发生了一定的改变。鉴于以上原因,基于视觉的方法难以实现一次性精确的转动角α的计算,需要通过至少2次的α值计算、并进行相应的转动实现文中实验所要求的跟踪恢复功能。但该指标相较于操作人员手持合作目标靶球、在半径为0.5 m的空间范围内寻找并对准光轴完成跟踪恢复操作,在速度上还是有较为明显的提升。此外,在实际工程应用中,基于所提出方法将激光束引导至对准合作目标靶球,激光跟踪仪自身的位置敏感探测器(PSD)会快速(1 ms量级)获得脱靶量信息,从而可使跟踪恢复过程大幅缩短至数十毫秒内。

-

针对激光跟踪仪快速跟踪恢复的实际需求,文中首先分析了基于视觉的跟踪恢复原理,并提出了基于主动红外视觉的跟踪恢复方法。然后阐述了主动红外视觉探测系统的系统构成,设计了目标快速识别与定位算法;最后搭建了跟踪恢复实验装置系统,从软件仿真测试、硬件系统功能及指标测试等多方面开展检测实验,对实验结果进行了深入的分析。实验结果表明,在红外相机镜头焦距选用16 mm,光源发散角为9.5°,目标距离为3 m的情况下,基于主动红外视觉探测系统能够在直径为0.5 m的空间范围内实现可靠的跟踪恢复功能,执行时间约为1.7~1.8 s,结合跟踪仪自身的伺服跟踪单元,跟踪恢复时间有望进一步大幅缩短,与操作员人工手动进行跟踪恢复相比具有显著提升。

Laser tracker target tracking recovery method based on detection system with active infrared vision

doi: 10.3788/IRLA20200254

- Received Date: 2020-11-05

- Rev Recd Date: 2020-12-15

- Available Online: 2021-05-12

- Publish Date: 2021-04-30

-

Key words:

- laser tracker /

- object tracking recovery /

- active infrared vision detection /

- fast detection and location

Abstract: In order to realize the automatic fast tracking recovery of laser tracker, a tracking recovery method based on active infrared vision was proposed. Firstly, the principle of tracking recovery was analyzed. Secondly, the active infrared vision detection system was designed by making full use of the strong reflection characteristic of the cooperative target ball of laser tracker. The system adopted infrared SLED as the active light source. The divergence angle of SLED light source was larger and the view angle of infrared camera was far greater than the detection range of PSD of laser tracker. Based on the above comprehensive advantages, the system can achieve a wide range of active detection for cooperative target ball. Then, the fast target recognition and location algorithm was studied, and a fast target recognition method based on cooperative target feature score was proposed. Finally, an experimental device of the tracking recovery system was set up. The verification experiments were carried out in the aspects of processing speed and recognition accuracy of the algorithm, tracking recovery range and speed of the system. The experimental results show that the average processing speed of the algorithm is about 28 frames per second, and the positioning deviation of 95.4% target center pixel is less than 5 pixel values. When the cooperative target ball is 3 meters away from the system, the tracking recovery system can achieve tracking recovery within the space of 0.5 meters which is completed in 1.8 seconds.

DownLoad:

DownLoad: